У США суд домагається регулювання використання штучного інтелекту юристами

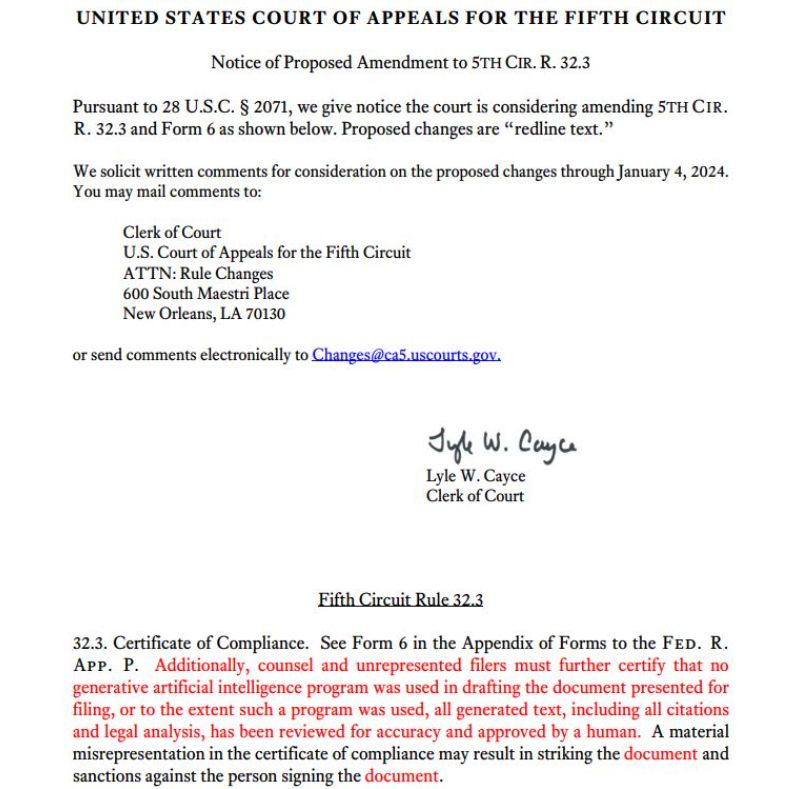

Федеральний апеляційний суд у Новому Орлеані розглядає пропозицію, яка зобов'яже юристів підтверджувати, чи використовували вони програми штучного інтелекту для складання документів, підтверджуючи чи незалежну людську перевірку точності тексту, згенерованого ШІ, чи відсутність роботи ШІ у їхніх судових матеріалах, передає Reuters.

21 листопада п'ятий окружний апеляційний суд США опублікував документ, у якому основна увага приділяється регулюванню використання інструментів генеративного IІ, включаючи ChatGPT OpenAI, юристами, які виступали перед судом.

Пропонована ухвала буде застосовуватися до адвокатів та позивачів без юридичного представництва, що постають перед судом, і зобов'язує їх підтверджувати, що якщо при подачі заяви використовувалася програма штучного інтелекту, як цитати, так і юридичний аналіз, то вони оцінювалися на предмет точності.

При цьому адвокати, які спотворюють інформацію про своє дотримання правила, можуть зіткнутися з перспективою скасування їхніх заяв та санкціями.

Зазначається, що до 4 січня 2024 року приймаються громадські коментарі до цієї пропозиції.

Раніше ми писали, що у Бразилії суддя використовував ChatGPT для винесення вироків.

Крім того, чат-бот ChatGPT обдурив адвоката: помилку одразу помітив суддя.

Додамо, у США звільнили адвоката, якого підставив ChatGPT.

Підписуйтесь на наш Telegram-канал t.me/sudua та на Google Новини SUD.UA, а також на нашу сторінку у Facebook та в Instagram, щоб бути в курсі найважливіших подій.