В США суд добивается регулирования использования искусственного интеллекта юристами

Федеральный апелляционный суд в Новом Орлеане рассматривает предложение, которое обяжет юристов подтверждать, использовали ли они программы искусственного интеллекта для составления документов, подтверждая либо независимую человеческую проверку точности текста, сгенерированного ИИ, либо отсутствие работы ИИ в их судебных материалах, передает Reuters.

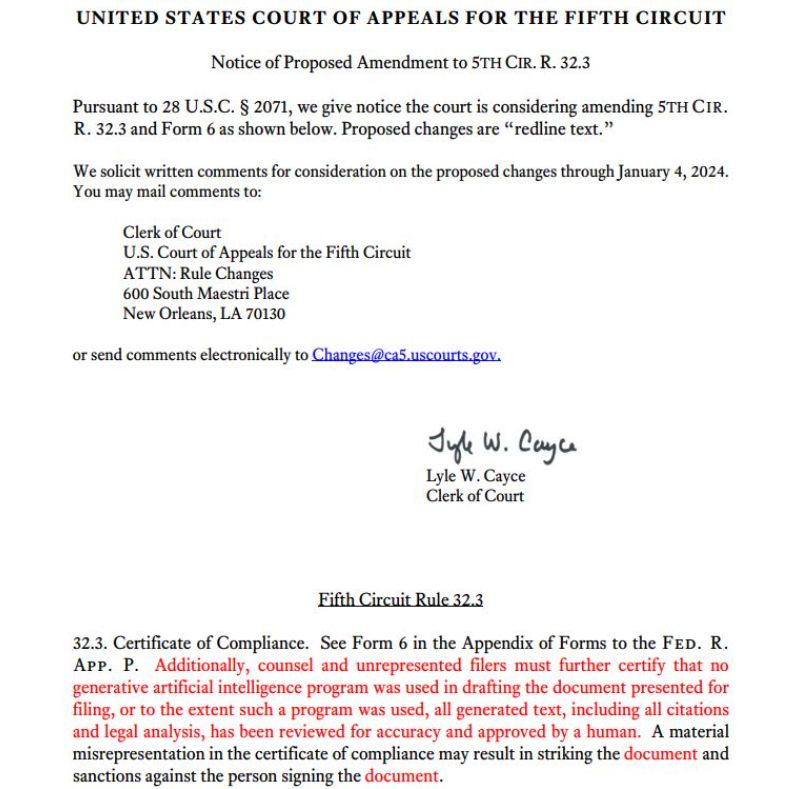

21 ноября пятый окружной апелляционный суд США опубликовал документ, в которым основное внимание уделяется регулированию использования инструментов генеративного ИИ, включая ChatGPT OpenAI, юристами, выступавшими перед судом.

Предлагаемое постановление будет применяться к адвокатам и истцам без юридического представительства, предстающим перед судом, и обязывает их подтверждать, что если при подаче заявления использовалась программа искусственного интеллекта, то как цитаты, так и юридический анализ оценивались бы на предмет точности.

При этом, адвокаты, которые искажают информацию о своем соблюдении правила, могут столкнуться с перспективой отмены их заявлений и санкциями.

Отмечается, что до 4 января 2024 года принимаются общественные комментарии по этому предложению.

Ранее сообщалось, что в Бразилии судья использовал ChatGPT для вынесения приговоров.

Кроме того, чат-бот ChatGPT обманул адвоката: ошибку сразу заметил судья.

Также в США уволили адвоката, которого подставил ChatGPT.

Подписывайтесь на наш Telegram-канал t.me/sudua и на Google Новости SUD.UA, а также на нашу страницу в Facebook и в Instagram, чтобы быть в курсе самых важных событий.